التزييف العميق (Deepfake) هو تقنية تعتمد على الذكاء الاصطناعي لإنشاء أو تعديل محتوى وسائط متعددة؛ مثل الصور والفيديوهات والنصوص والأصوات بطريقة تجعلها تبدو واقعية جدًا. يستخدم التزييف العميق الشبكات العصبية الاصطناعية، وبخاصة تقنية الشبكات التوليدية التنافسية (Generative Adversarial Networks - GANs)، لتوليد هذه المحتويات المزيّفة.

يعتمد التزييف العميق، بشكل كبير، على تقنيات الذكاء الاصطناعي والتعلم العميق. تطوّرت هذه التقنية بفضل التحسينات في قدرات الحوسبة وتوافر كميات ضخمة من البيانات لتدريب النماذج. وتُعد تقنيات الذكاء الاصطناعي مثل GANs المحور الأساس في تمكين التزييف العميق من الوصول إلى مستوى عالٍ من الواقعية.

يتمّ التزييف العميق على تدريب نموذجين من الشبكات العصبية: الأول هو المولد (Generator) الذي يقوم بإنشاء المحتوى المزيّف، والثاني هو المميز (Discriminator) الذي يحاول تمييز المحتوى المزيّف من الحقيقي. ويتنافس النموذجان في ما بينهما، حيث يسعى المُولد لتحسين جودة المحتوى المزيّف إلى أن يتمكّن من خداع المُميز بشكل متزايد.

تمرّ عملية إنشاء التزييف العميق بعدة مراحل؛ ابتدءً من جمع كمية كبيرة من البيانات الحقيقية من صور وفيديوهات وأصوات لأشخاص حقيقيين، ثمّ يجري تدريب الشبكة العصبية على هذه البيانات لتتعلم الأنماط والتفاصيل الدقيقة للأصوات والصور والحركات ليقوم المُولد بإنشاء محتوى مزيّف بناءً على الأنماط التي تعلّمها، بينما يحاول المُميز اكتشاف هذه المزيّفات وتحسين النموذج. ويستمر النموذجان في التنافس وتحسين الأداء حتّى يصبح المحتوى المزيّف عالي الجودة وصعب التمييز عن الحقيقي.

كما باستطاعة التزييف العميق العمل على إنشاء صور لأشخاص غير حقيقيين أو تعديل صور حقيقية لتبدو مختلفة تمامًا، مثل تغيير ملامح الوجه، أو إضافة عناصر جديدة إلى الصورة. وكما يمكنه إنشاء فيديوهات مزيّفة تُظهر أشخاصًا يقومون بأفعال أو يتحدثون بكلمات لم يقوموا بها أو يقولوها في الواقع، ويستخدم في ذلك تقنيات تتبع الوجه وتزامن الحركة مع الصوت. ويمكن للتزييف العميق إنتاج نصوص تبدو كأنّ أشخاصًا حقيقيين قد كتبوها. يمكن استخدام هذه النصوص في كتابة مقالات أو إنشاء محادثات وهمية، ويمكنه توليد أصوات تحاكي صوت أشخاص معينين بدقة عالية، ما يتيح إنشاء تسجيلات صوتية مزيّفة. يعتمد ذلك على تحليل الأنماط الصوتية والتردّدات المميزة لكل صوت.

من المخاطر التي يمكن رصدها لعمليات التزييف العميق؛ نشير إلى أنه يمكن استخدام الفيديوهات المزيّفة في التلاعب بالعقول الشابة وتوجيههم إلى سلوكيات غير مرغوبة. قد تؤدي هذه المحتويات إلى تعرض الأطفال لمواقف مخيفة أو مضللة. كذلك يمكن استخدام الصور والفيديوهات المزيّفة للإساءة إلى سمعة النساء أو للابتزاز الإلكتروني إذ تُستخدم هذه التقنية لإنشاء محتوى غير لائق أو مزعج يُنسب إلى النساء بشكل غير قانوني. ويمكن أن تؤدي الفيديوهات المزيّفة إلى خلق صراعات وخلافات داخل الأسرة بناءً على معلومات مغلوطة أو انه يمكن استخدام هذه الفيديوهات لإثارة الشكوك بين أفراد العائلة أو بين الأصدقاء. وبذلك يهدّد التزييف العميق ثقة الجمهور في وسائل الإعلام والمحتوى الرقمي، ما يخلق بيئة خصبة لنشر الأخبار الكاذبة والمعلومات المضللة. ويمكن أن تؤدي هذه التقنيات إلى زعزعة استقرار المجتمعات وزيادة التوترات السياسية والاجتماعية.

من الأمثلة المشهورة عن استخدام التزييف العميق:

- الفيديو المزيّف لرئيسة مجلس النواب الأميركي نانسي بيلوسي السابقة؛ إذ نُشر فيديو مزيّف يظهرها وهي تتحدث بطريقة غير واضحة وكأنّها في حال سُكر. أثار هذا الفيديو جدلًا واسعًا وأثار تساؤلات حول مصداقية الفيديوهات المنتشرة على الإنترنت.

- الفيديو المزيّف لمارك زوكربيرغ: نُشر فيديو مزيّف يظهر مؤسس فيسبوك مارك زوكربيرغ وهو يتحدث عن كيفية سرقة البيانات الشخصية للمستخدمين. كان هذا الفيديو جزءًا من حملة توعية حول مخاطر التزييف العميق، ولكنه أظهر القدرة العالية لهذه التقنية على خلق محتوى واقعي تمامًا.

- التزييف العميق في الانتخابات: تم استخدام التزييف العميق في الانتخابات للتلاعب بالرأي العام من خلال إنشاء فيديوهات وصور مزيّفة للمرشحين تظهرهم في مواقف محرجة أو مشينة، مما يؤثر على نتائج الانتخابات ويزعزع الثقة في العملية الديمقراطية.

.jpg)

على الرغم من التطور في تقنيات اكتشاف التزييف العميق، إلا أن اكتشاف التزييف قد يحدث بعد فوات الأوان، ما يعني أن الهدف من التزييف قد تحقق بالفعل. على سبيل المثال، يمكن أن يكون الفيديو المزيّف قد انتشر، بشكل واسع، وأثر في الرأي العام أو تسبّب بضرر لا يمكن إصلاحه. في الحياة السياسية، قد يؤثر الفيديو المزيّف في نتائج الانتخابات أو يخلق توترات بين الدول. في الحياة الاجتماعية، قد يتسبب التزييف العميق في تدمير سمعة شخص ما أو خلق صراعات داخل المجتمعات.

كيفية الحد من التزييف العميق واكتشافه

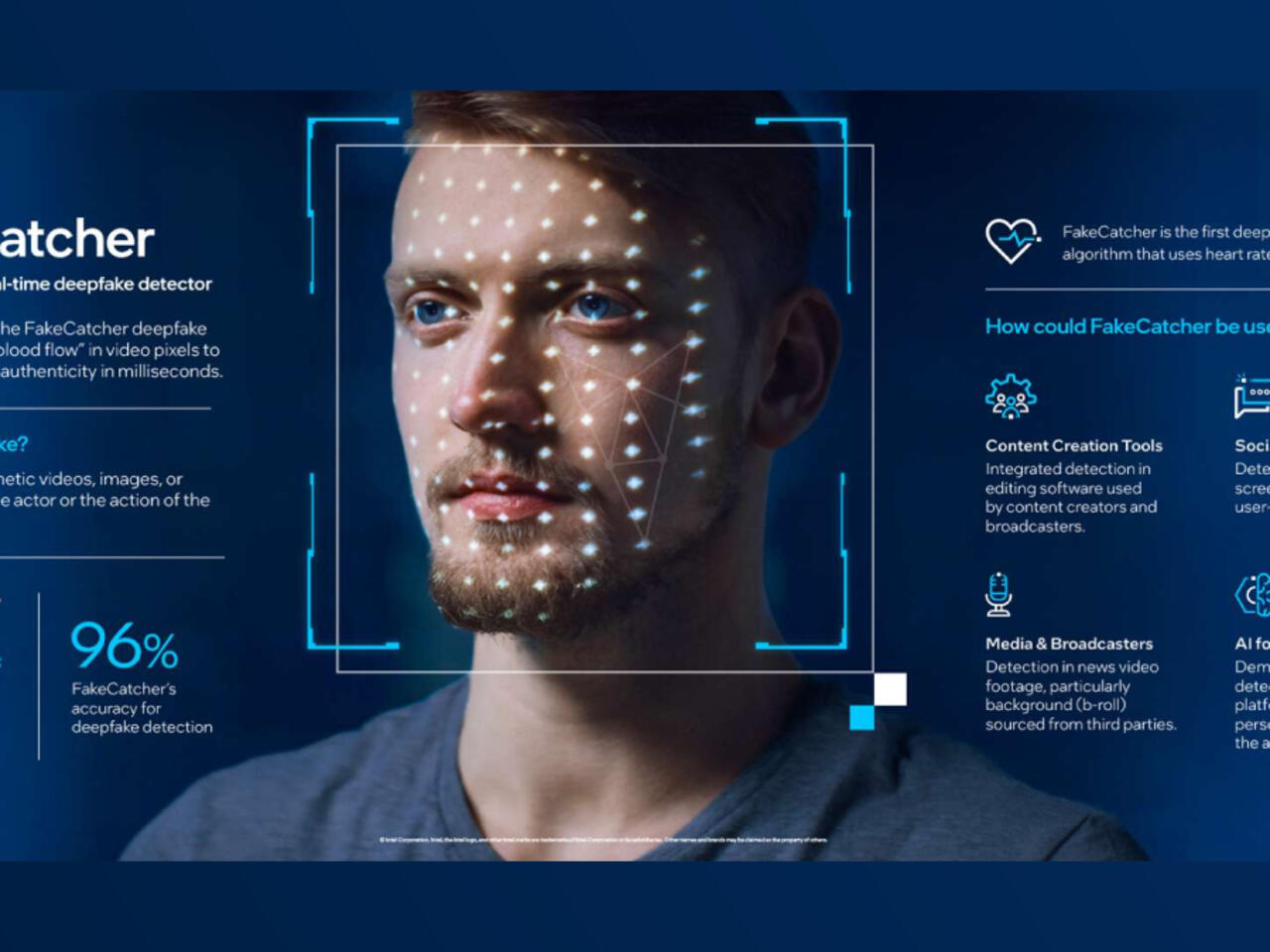

- تقنيات الكشف: تطوير واستخدام أدوات وتقنيات تعتمد على الذكاء الاصطناعي لاكتشاف المحتوى المزيّف. تتضمن هذه التقنيات تحليل البيكسلات والفلاتر الرقمية وأنماط الفيديو غير الطبيعية منها على سبيل المثال موقع deepware.ai الذي يقوم بمسح مقطع فيديو مشبوه لمعرفة ما إذا كان قد جرى التلاعب به صناعيًا وموقع aiornot.com الذي يقوم بتحديد ما إذا كانت الصورة قد أنشئت بواسطة الذكاء الاصطناعي أو الإنسان، وهذا الموقع quillbot.com/ai - content - detector الذي يقوم بإخبارك بنسبة إسهام الذكاء الاصطناعي في النص.

2. التوعية: توعية الجمهور بمخاطر التزييف العميق وكيفية التعرّف إلى المحتويات المزيّفة. إذ يمكن تنظيم ورش عمل وحملات إعلامية لتعليم الناس كيفية التمييز بين المحتوى الحقيقي والمزيّف.

3. التشريعات: وضع قوانين وتنظيمات تجرّم إنتاج وتوزيع المحتويات المزيّفة. يمكن للحكومات إصدار قوانين لحماية الأفراد من التزييف العميق وفرض عقوبات صارمة على من يستخدم هذه التقنية بشكل غير قانوني.

4. التعاون بين المؤسسات: تشجيع التعاون بين الحكومات والمنظمات التقنية والشركات التكنولوجية لتطوير حلول فعالة لمواجهة التزييف العميق. يمكن تبادل المعلومات والتقنيات بين الجهات المختلفة لتعزيز القدرات في مواجهة هذا الخطر.

5. التحقق من المصادر: تعزيز ثقافة التحقق من المصادر والمحتويات قبل تصديقها ونشرها. يجب على الأفراد التحقق من مصداقية المحتوى قبل مشاركته على وسائل التواصل الاجتماعي أو أي منصة أخرى.

6. الوقاية: يجب على الأفراد الحذر عند نشر صورهم أو مقاطع فيديو أو تسجيلات صوتية على الإنترنت. إذا لم يتمكّن المزيّف من الحصول على مواد حقيقية تتعلق بك، سيكون من الصعب عليه إنشاء محتوى مزيّف مقنع. لذلك، من المهم توخي الحذر بشأن المعلومات الشخصية والوسائط التي يجري مشاركتها عبر الإنترنت.

التزييف العميق يمثل تحديًا كبيرًا في العصر الرقمي، ويجب علينا مجتمعيًا العمل معًا لمواجهة هذا الخطر من خلال التوعية والتقنيات الحديثة والتشريعات المناسبة. وبالتحلي بالوعي واليقظة يمكننا حماية أنفسنا وأسرنا ومجتمعنا من الآثار السلبية لهذه التقنية. يعدّ التعاون بين الأفراد والمؤسسات والحكومات أمرًا ضروريًا للحد من انتشار التزييف العميق وضمان سلامة المحتوى الرقمي والمعلومات المتداولة.

علي أبو الحسن/ موقع العهد الإلكتروني